AI公开个人信息用户可能更感同身受

在一项新研究中,当在线拟人化人工智能 (AI) 代理似乎在与参与者聊天时透露有关自己的个人信息时,参与者表现出更多的同理心。日本东京 SOKENDAI 研究生院的 Takahiro Tsumura 和同样位于东京的国立信息学研究所的 Seiji Yamada 于 2023 年 5 月 10 日在开放获取期刊 PLOS ONE 上展示了这些发现。

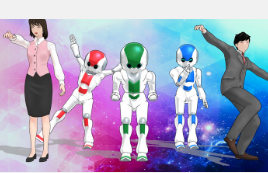

人工智能在日常生活中的使用正在增加,这引起了人们对可能有助于提高人们对人工智能代理的信任和接受程度的因素的兴趣。先前的研究表明,如果人造物体能引起同理心,人们就更有可能接受人造物体。例如,人们可能会对清洁机器人、模仿宠物的机器人以及在网站上提供帮助的拟人化聊天工具产生共鸣。

早期的研究也强调了披露个人信息在建立人际关系中的重要性。基于这些发现,Tsumura 和 Yamada 假设拟人化 AI 代理的自我披露可能会增强人们对这些代理的同理心。

为了验证这个想法,研究人员进行了在线实验,参与者与在线 AI 代理进行基于文本的聊天,该代理在视觉上由类人插图或拟人机器人插图表示。聊天涉及一个场景,其中参与者和代理是在代理工作场所午休的同事。在每次对话中,代理人似乎都会自我披露与工作高度相关的个人信息、与爱好不太相关的信息,或者没有任何个人信息。

最终分析包括来自 918 名参与者的数据,他们使用标准同理心问卷评估了对 AI 代理的同理心。研究人员发现,与不太相关的自我披露相比,人工智能代理与工作相关的高度相关的自我披露与参与者的更大同理心有关。缺乏自我表露与压抑的同理心有关。代理人作为人类或拟人化机器人的外观与同理心水平没有显着关联。

这些发现表明,人工智能代理的自我披露可能确实会引起人类的同理心,这可能有助于为人工智能工具的未来发展提供信息。

作者补充说:“这项研究调查了拟人代理人的自我表露是否会影响人类的同理心。我们的研究将改变社会中使用人工制品的负面形象,并为未来人类与拟人代理之间的社会关系做出贡献。”

声明:本站所有文章资源内容,如无特殊说明或标注,均为采集网络资源。如若本站内容侵犯了原著者的合法权益,可联系本站删除。